CLIP, OpenAI tarafından geliştirilen Contrastive Language-Image Pretraining (Karşılaştırmalı Dil-Görsel Ön Eğitimi) modelidir . Modelin adı, metin ve görsel çiftlerini karşılaştırarak öğrenme yeteneğinden gelmektedir. Bu sayede, metinsel açıklamaları görsellerle etkili bir şekilde ilişkilendirebilmektedir.

CLIP, görselleri ve metinleri ilişkilendiren çok-modlu bir yapay zeka modelidir. Geleneksel etiketlenmiş veri kümelerine dayalı denetimli eğitim (supervised learning) gerektirmeden çalışır. Bu sayede veri hazırlığında önemli ve zaman alan bir aşama olan etiketleme safhasını gerektirmemektedir. İnternetten büyük miktarda görsel-metin çifti öğrenerek geniş bir görsel kavram yelpazesinde genelleme yapabilir.

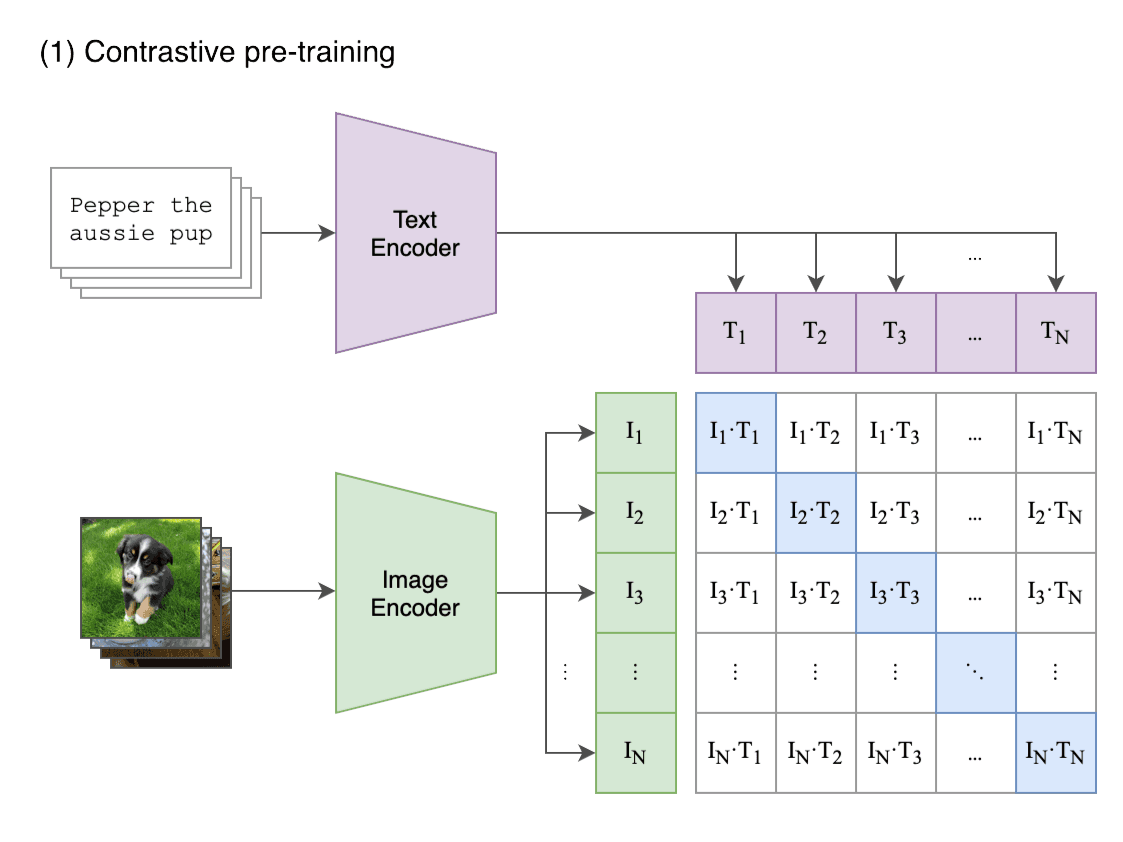

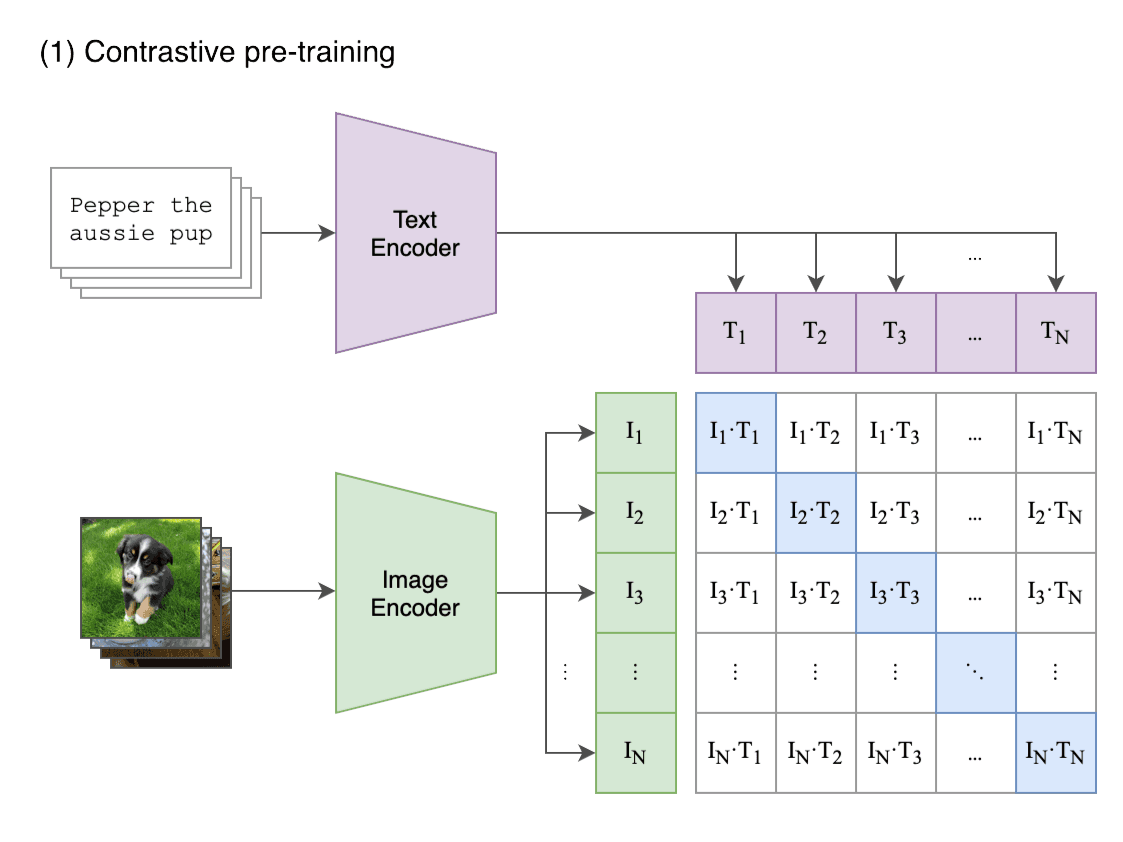

CLIP, metin ve görselleri eşleştirmek için karşılaştırmalı öğrenme (contrastive learning) yöntemini kullanır. Model, görselleri ve metinleri ayrı ayrı işleyerek, bunları ortak bir çok boyutlu vektör uzayında temsil eder ve ardından aralarındaki benzerliği hesaplar【1】 .

CLIP, iki ayrı sinir ağı kullanarak hem metinleri hem de görselleri vektör temsiline (embedding) dönüştürür:

Bu kodlayıcılar, milyonlarca görsel-metin çifti üzerinde eğitilir, böylece model hem görsellerin hem de metinlerin anlamını ortak bir uzay temsilinde öğrenir.

Eğitim sırasında CLIP, bir minibatch (minik yığın) içindeki tüm görselleri ve metinleri birbiriyle karşılaştırır:

Bu süreçte, Kosinüs Benzerliği (Cosine Similarity) metriği kullanılır. Vektörler arasındaki benzerlikler hesaplanarak model eğitilir.

【2】

Eğitim tamamlandığında, CLIP herhangi bir yeni görüntüyü, özel bir eğitim gerektirmeden, bir metin açıklamasıyla eşleştirebilir. Çünkü model, önceden karşılaşmadığı konseptleri bile, genelleştirilmiş bir uzayda öğrendiği için tanıyabilir. Bu, CLIP'in en güçlü yönlerinden biridir.

Bu prensipler sayesinde CLIP, yalnızca görsel sınıflandırmada değil, aynı zamanda metinden görsele üretim, içerik denetimi ve robotik algılama gibi alanlarda da önemli bir gelişme sağlamıştır.

CLIP, bilgisayarlı görmeye yenilik getirerek göreve özel veri setine olan ihtiyacı ortadan kaldırdı. Tek bir göreve özel olarak eğitilen geleneksel modellerin aksine, CLIP sıfır atış öğrenme (zero-shot learning) yeteneğine sahiptir. Yani, önceden belirlenmiş kategoriler için özel olarak eğitilmeden görselleri tanıyabilir ve sınıflandırabilir【3】 . Bu da modelin gerçek hayat uygulamalarına daha büyük ölçüde uyum sağlamasını sağladı. Aynı zamanda CLIP’in çok yönlülüğü ve sıfır atış (zero-shot) performansı, onu görsel üretiminden arama motorlarına kadar birçok modern yapay zeka uygulaması için temel bir model haline getirmiştir.

Görsel sınıflandırma ve arama: CLIP, doğal dil komutlarına dayanarak görselleri tanıyabilir ve kategorize edebilir【4】 . Önceden etiketleme gerektirmemesi ile daha önce görmediği bir görsel üzerine de benzer görseller ile yorum yapabilir.

Metinden görsele modeller: DALL-E gibi üretken yapay zeka modellerinin temel bileşenlerinden biridir. Verilen metinde istenen stil ve kavramlara benzer resim kümesini tespit ederek kullanıcıya metinle istenene daha yakın görseller sunabilir.

İçerik denetimi: Uygunsuz veya zararlı görsellerin tespit edilip filtrelenmesine yardımcı olur. Uygunsuz içerikleri kümeleyerek görsel olarak onlara benzeyen yeni uygunsuz içerikleri de filtreleyebilir.

He, Y., Sui, Y., He, X., Liu, Y., Sun, Y., & Hooi, B. (2025). UniGraph2: Learning a Unified Embedding Space to Bind Multimodal Graphs. arXiv preprint arXiv:2502.0080. Erişim Adresi.

Lv, S. L., Chen, Y. Y., Zhou, Z., Li, Y. F., & Guo, L. Z. (2025). Contrast-Aware Calibration for Fine-Tuned CLIP: Leveraging Image-Text Alignment. arXiv preprint arXiv:2501.19060. Erişim Adresi.

OpenAI, Github. CLIP Repo. Erişim Adresi.

Radford, A., Kim, J.W., Hallacy, C., Ramesh, A., Goh, G., Agarwal, S., Sastry, G., Askell, A., Mishkin, P., Clark, J., Krueger, G., & Sutskever, I. (2021). Learning Transferable Visual Models From Natural Language Supervision. International Conference on Machine Learning. Erişim Adresi.

Tellez, A., Pumperla, M., & Malohlava, M. (n.d.). Mastering Machine learning with SPARK 2.X. Packt Publishing Ltd.

[1]

Radford, A., Kim, J.W., Hallacy, C., Ramesh, A., Goh, G., Agarwal, S., Sastry, G., Askell, A., Mishkin, P., Clark, J., Krueger, G., & Sutskever, I. (2021). Learning Transferable Visual Models From Natural Language Supervision. International Conference on Machine Learning.

[2]

Tellez, A., Pumperla, M., & Malohlava, M. (n.d.). Mastering Machine learning with SPARK 2.X. Packt Publishing Ltd.

[3]

Lv, S. L., Chen, Y. Y., Zhou, Z., Li, Y. F., & Guo, L. Z. (2025). Contrast-Aware Calibration for Fine-Tuned CLIP: Leveraging Image-Text Alignment. arXiv preprint arXiv:2501.19060.

[4]

He, Y., Sui, Y., He, X., Liu, Y., Sun, Y., & Hooi, B. (2025). UniGraph2: Learning a Unified Embedding Space to Bind Multimodal Graphs. arXiv preprint arXiv:2502.00806.

CLIP Fonksiyonu

CLIP Çalışma Prensibi

Metin ve Görsel Kodlama (Text & Image Encoding)

Karşılaştırmalı Öğrenme (Contrastive Learning) ve Kosinüs Mesafesi (Cosine Distance)

Sıfır Atış Öğrenme (Zero-Shot Learning)

Literatüre Katkısı

Yaygın Kullanım Alanları